Gegen Hassrede hilft Empathie

Hasserfüllte Kommentare (engl. Hate Speech) im Internet sind zu einem weltweiten Problem geworden. In sozialen Netzwerken werden sexuelle Minderheiten diffamiert, Angehörige bestimmter Religionsgemeinschaften eingeschüchtert und ethnische Gruppen aufgewiegelt. Hate Speech ist aber auch eine Bedrohung für die Demokratie, da sie die Angegriffenen davon abhalten kann, sich an einer öffentlichen Diskussion zu beteiligen.

Zwar verfügen viele Plattformen über teils ausgeklügelte Filter, um Hasskommentare zu löschen. Doch diese allein können das Problem nicht wirklich eindämmen. Facebook zum Beispiel ist nach eigener Einschätzung (beziehungsweise gemäss den im Oktober 2021 geleakten internen Dokumenten) nicht in der Lage, mehr als 5 Prozent der geposteten Hasskommentare zu entfernen. Dazu kommt, dass die automatischen Filter ungenau sind und tendenziell im Konflikt mit der Meinungsäusserungsfreiheit stehen.

Empathie mit Betroffenen erwirken

Eine Alternative zum Löschen ist gezielte Gegenrede (engl. Counterspeech). Counterspeech wird von zahlreichen Organisationen verwendet, die sich im Internet gegen Hate Speech einsetzen. Wissenschaftliche Erkenntnisse zur Effektivität dieser Strategie gab es bisher aber kaum. Ein Forschungsteam um Dominik Hangartner, ETH-Professor für Politikanalyse, hat nun gemeinsam mit Kollegen an der Universität Zürich untersucht, welche Botschaften Hassrednerinnen und Hassredner dazu bewegen können, dies in Zukunft zu unterlassen.

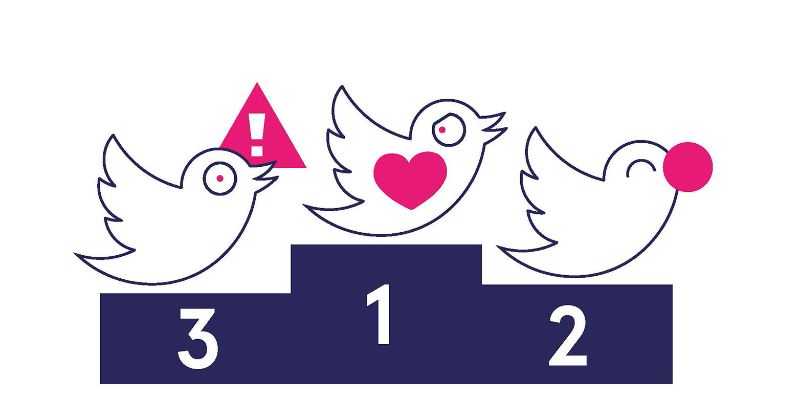

Mit Methoden des maschinellen Lernens identifizierten die Forschenden 1350 englischsprachige Twitter-User, die rassistische oder fremdenfeindliche Inhalte publiziert hatten. Einen Teil dieser Hass-Twitternden teilten sie einer Kontrollgruppe zu, auf die anderen wandten sie nach dem Zufallsprinzip eine von drei häufig verwendeten Counterspeech-Strategien an: Nachrichten, die Empathie mit der von Rassismus betroffenen Gruppe erzeugen, Humor oder einen Hinweis auf mögliche Konsequenzen.

Die Ergebnisse, die soeben in der Wissenschaftszeitschrift Proceedings of the National Academy of Sciences (PNAS) publiziert worden sind, fallen deutlich aus: Nur Antworten, die Empathie mit den von der Hassrede betroffenen Personen erwirken, sind geeignet, die Hass-Schreiber zu einer Verhaltensänderung zu bewegen. Eine solche Erwiderung könnte beispielsweise lauten: «Ihr Post ist für Jüdinnen und Juden sehr schmerzhaft…» Im Vergleich zur Kontrollgruppe versandten die Hass-Twitterer nach einer solchen Empathie-fördernden Intervention rund ein Drittel weniger rassistische oder fremdenfeindliche Kommentare. Zudem erhöhte sich die Wahrscheinlichkeit deutlich, dass ein Hass-Tweet wieder gelöscht wurde. Auf humorvollen Counterspeech reagierten die Hass-Twitternden hingegen kaum. Selbst der Hinweis, dass auch Familie, Freunde und Kollegen des Senders dessen Hass-Nachrichten sehen, wirkte nicht. Das ist insofern bemerkenswert, als diese beiden Strategien häufig von Organisationen, welche sich gegen Hassrede einsetzen, angewandt werden.

«Wir haben sicher kein Allzweckmittel gegen Hate Speech im Internet gefunden, dafür aber wichtige Hinweise, welche Strategien funktionieren könnten und welche nicht», sagt Hangartner. Noch zu untersuchen bleibt, ob alle Empathie-basierten Antworten gleich wirken oder ob bestimmte Formulierungen effektiver sind. Zum Beispiel können Hassredner aufgefordert werden, sich in das Opfer hineinzuversetzen. Oder man kann sie bitten, eine analoge Perspektive einzunehmen («Wie würdest Du Dich fühlen, wenn Leute so über Dich sprechen würden?»).

Lehre und Forschung verschmelzen

Neben den Professoren Karsten Donnay und Fabrizio Gilardi vom Digital Democracy Lab der Universität Zürich waren auch 13 Master-Studierende des ETH Center for Comparative and International Studies (CIS) massgeblich am Projekt beteiligt. Die Studierenden wirkten in allen Phasen des Projekts mit, von der Entwicklung eines Algorithmus zum Erkennen von Hass-Tweets über das Testen der Strategien bis zur statistischen Analyse und dem Projektmanagement. «Diese neue Art eines kollaborativen Forschungsseminars ist für mich exemplarisch für eine Ausbildung, die den Studierenden nicht nur das daten- und sozialwissenschaftliche, sondern auch forschungsethische Rüstzeug vermittelt, damit sie die Entwicklung im Bereich Digitalisierung und soziale Medien positiv mitgestalten können», sagt Hangartner.

In diesem Sinn äussern sich auch involvierte Studierende. «Wir haben nicht nur über die Forschung anderer gelesen, wir wissen jetzt auch, wie ein grösseres Forschungsprojekt funktioniert», sagt Laurenz Derksen. «Auch wenn der Aufwand gross war: Die Untersuchung hat ein Feuer in mir entfacht und mich für die ambitionierte und kollaborative Forschung begeistert», meint Derksen.

Buket Buse Demirci, inzwischen Doktorandin, fand, das Projekt sei weit über das hinausgegangen, was bei Seminaren üblich ist. Als Beispiel nennt sie den Pre-Analysis Plan: die öffentliche Registrierung aller Untersuchungsschritte vor Studienbeginn, womit die Glaubwürdigkeit der statistischen Analysen und Verlässlichkeit der Resultate erhöht wird. Motivierend sei auch, dass alle 13 Studierenden in einem der renommiertesten interdisziplinären Fachzeitschriften als Co-Autoren aufgeführt sind. «Ich habe an einer an Untersuchung mitgearbeitet, die nicht nur wissenschaftlich publiziert wurde, sondern auch in der realen Welt etwas bewirken könnte», sagt Demirci.

Praxisbezug durch NGO und Medien

Kollaborative Forschung im Rahmen einer Lehrveranstaltung könne auch einmal mit einem Null-Ergebnis enden, ist sich Hangartner bewusst. Die Erfahrung sei aber für die Studierenden auf jeden Fall wertvoll. Sie könnten so antizipieren, was sie bei einem Doktorat erwartet, und auch in zahlreichen Berufen sei praktische Forschungserfahrung ein Plus.

Das kollaborative Forschungsseminar ist Teil eines umfassenderen Projekts zur Entwicklung von Algorithmen zur Erkennung von Hassrede und dem Testen und Verfeinern von weiteren Counterspeech-Strategien. Dabei arbeitet das Forschungsteam mit dem Frauendachverband alliance F zusammen, welche das zivilgesellschaftliche Projekt Stop Hate Speech initiiert hat. Durch die Zusammenarbeit gewinnen die WissenschaftlerInnen direkte Erkenntnisse aus der Praxis und liefern eine empirische Basis, damit alliance F den Einsatz und Inhalt der Gegenrede optimieren kann.

«Die Forschungsergebnisse stimmen mich sehr optimistisch. Das erste Mal liegen uns Ergebnisse vor, welche mittels eines unter realen Bedingungen durchgeführten Experimentes die Wirksamkeit von Counterspeech empirisch belegen können», sagt Sophie Achermann, Geschäftsführerin von alliance F und Co-Initiantin von Stop Hate Speech. Weiter beteiligt an dem von der Schweizer Innovationsförderagentur Innosuisse geförderten Forschungsprojekt sind unter anderem die Medienhäuser Ringier (Blick) und TX Group (20 Minuten).